Wichtigste Erkenntnisse:

- Jede Technik hat spezifische Einsatzgebiete

- Praktische Beispiele zeigen dir direkt die Anwendung

- Sofort umsetzbare Strategien

- Funktioniert mit allen KI-Modellen, egal ob ChatGPT, Claude, Gemini oder Llama.

- Techniken können miteinander kombiniert werden.

Inhaltsverzeichnis

Was ist ein Prompt?

Ein Prompt ist eine Eingabeaufforderung, die verwendet wird, um eine bestimmte Reaktion von einem System oder einer Person zu erzielen. In der Informatik, besonders bei KI-Modellen, dient ein Prompt dazu, eine gezielte Antwort zu generieren.

Er stellt den Anfang einer Aufgabe dar und gibt die Richtung der Antwort vor, z. B. informativ oder kreativ. Prompts sind flexibel und können unterschiedlich formuliert werden, um verschiedene Antworten zu erhalten. Eine wissenschaftliche Erörterung der verschiedenen Techniken findest du hier.

Je detaillierter und strukturierter Ihre Eingabe ist, desto besser kann die KI das Anliegen verstehen und erfüllen.

Was macht einen guten Prompt aus?

- Klares Ziel: Gib an, was die KI tun soll (z. B. ein Gedicht schreiben, einen Text übersetzen, einen Artikel zusammenfassen).

- Kontext und Einschränkungen : Teile relevante Hintergründe, Einschränkungen oder den gewünschten Stil an (z. B. Zielgruppe, Ton, Länge) mit.

- Beispiele: Zeige der KI anhand von Beispielen, was du erwartest.

- Schlüsselwörter: Verwende relevante Schlüsselwörter, um die gewünschte Ausgabe zu verdeutlichen.

Wie merkt man sich gute Prompts?

Ganz ehrlich? Ich teste zu viele Prompts und kann mir die nicht merken. Deshalb nutze ich 2 verschiedene Methoden.

Voilá

Voilá ist ein Chrome Plugin, mit dem man ChatGPT nutzen kann. Ein Abo von Open AI ist nicht notwendig. Das Tool kann man innerhalb des Browsers überall nutzen.

Eine Prompt Datenbank ist integriert. Mit einem Klick wird der Prompt eingefügt. Eine ausführliche Vorstellung findest du hier (klicken).

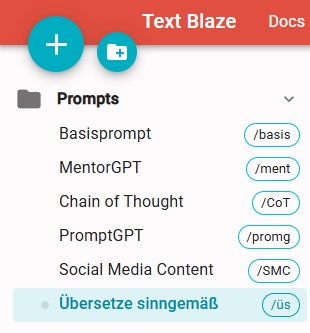

Text Blaze ist eine kostenlose Datenbank, auf die man über ein Chrome Plugin zugreifen kann. In dieser kann man häufig verwendete Texte speichern und im Browser mit /[Text] abrufen.

Das ist super geeignet für alle Texte, die man häufig benutzt. Egal ob in Emails oder Prompts.

Zero-Shot Prompting

Was ist das?

Zero-Shot Prompting1 ist eine Methode, bei der KI-Modelle Aufgaben lösen, ohne speziell darauf trainiert zu sein. Das Modell nutzt sein vortrainiertes Wissen und analysiert den Kontext der Anfrage, um passende Antworten zu generieren.

Diese Technik ist besonders nützlich, wenn schnelle Ergebnisse benötigt werden oder kein spezifisches Training verfügbar ist.

Zero-Shot Prompting nutzt die Fähigkeit moderner KI-Systeme, flexibel und effizient auf unterschiedliche Aufgaben zu reagieren, indem sie ihr breites Wissen nutzen.

Vorteile:

- Vielseitiger Einsatz für unterschiedliche Aufgaben.

- Spart Zeit, da keine Beispiele oder Trainingsdaten nötig sind.

- Schnelle Anpassung an neue Anfragen.

Nachteile:

- Erfordert präzise Formulierung der Anfragen.

- Antwortqualität kann variieren.

Praktische Beispiele:

Textklassifikation

Klassifiziere den folgenden Text als entweder 'positiv', 'neutral' oder 'negativ':

Der neue Film war interessant, aber ich hatte höhere Erwartungen.Der Text lässt sich als 'neutral' klassifizieren.Übersetzung

Übersetze den folgenden deutschen Satz sinngemäß ins Spanische: Es wird bald der erste Schnee fallen.Pronto caerá la primera nieve.Zero Shots eignen sich für Inhaltserstellung und Wissensabruf.

Few-Shot Prompting

Was ist das?

Few-Shot Prompting2 ist eine Technik im Prompt Engineering, bei dem man einige wenige Beispiele direkt im Prompt präsentiert. So kann die KI präzisere und kontextualisierte Antworten liefern. Diese Methode ist besonders nützlich, wenn man spezifische Ergebnisse, Ausgabestrukturen, Töne und Stile vermitteln möchte.

Bei Few-Shot Prompting werden typischerweise 2–5 Beispiele verwendet, die dem Modell als Kontext und „Mini-Training“ dienen. Dadurch kann das Modell Nuancen und spezifische Anforderungen besser erfassen. Durch die Bereitstellung von Beispielen im Prompt kann das Modell die gewünschte Struktur und den Kontext besser verstehen.

Vorteile:

- Verbesserte Ausgabequalität durch präzise und konsistente Antworten.

- Flexibilität in der Anpassung an spezifische Aufgaben.

- Besseres Kontextverständnis des Modells.

- Effizienz bei begrenzten Datenmengen.

Nachteile

- Qualität der Beispiele ist entscheidend für die Ausgabequalität.

- Risiko von Verzerrungen bei unausgewogenen Beispielen.

- Auswahl passender Beispiele kann zeitaufwändig sein.

Praktische Beispiele:

Sentimentanalyse

Klassifiziere die folgenden Sätze als positiv, neutral oder negativ:

1. "Der Film war fantastisch!" -> positiv

2. "Das Wetter ist heute bewölkt." -> neutral

3. "Ich hasse Montage." -> negativ

Klassifiziere nun diesen Satz:

"Die neue Kaffeemaschine funktioniert einwandfrei.""positiv"In diesem Beispiel lernt das Modell anhand der gegebenen Beispiele, wie es Sätze in Bezug auf ihr Sentiment klassifizieren soll.

Formatierung von Kontaktinformationen

Formatiere die folgenden Kontaktinformationen im angegebenen Format:

1. Name: Max Schmidt, Email: max@example.com, Tel: 0123456789

-> Max Schmidt | max@example.com | 0123456789

2. Name: Anna Hammer, Email: anna.h@mail.de, Tel: 9876543210

-> Anna Hammer | anna.h@mail.de | 9876543210

Formatiere nun diese Informationen:

Name: Lisa Klein, Email: lisa.klein@web.de, Tel: 1234543210Lisa Klein | lisa.klein@web.de | 1234543210In diesem Fall lernt das Modell, wie es Kontaktinformationen in einem bestimmten Format strukturieren soll.

Few Shots sind gut für die Inhaltserstellung und Datenanalyse geeignet.

Chain of Thought (CoT) Prompting

Was ist das?

Chain of Thought (CoT) Prompting3 ziele darauf ab, die logischen Denkfähigkeiten von großen Sprachmodellen zu verbessern und deren Denkprozesse transparenter zu machen. Mit der Methode wird der ‚Denkprozess‘ Schritt für Schritt offengelegt, anstatt direkt eine Antwort zu geben. Eine ausführliche Anleitung kannst du hier nachlesen.

Vorteile:

- Verbesserte Genauigkeit bei komplexen Aufgaben.

- Erhöhte Nachvollziehbarkeit der Denkprozesse.

- Flexibilität bei der Anwendung auf verschiedene Aufgabentypen.

- Effizienz, da oft wenige Beispiele ausreichen.

- Aktivierung inhärenter Fähigkeiten großer Sprachmodelle.

Nachteile:

- Kann zeitintensiver sein, da der Denkprozess detailliert aufgeschlüsselt wird.

- Erfordert sorgfältige Formulierung der Prompts, um den gewünschten Detaillierungsgrad zu erreichen.

- Nicht immer geeignet für sehr einfache oder schnelle Aufgaben, wo eine direkte Antwort genügt.

Praktische Beispiele:

Mathematische Problemlösung

Löse folgende Aufgabe und erkläre dabei jeden Schritt deiner Berechnung:

Ein Obstgeschäft hat 200 Äpfel auf Lager. Am Montag werden 30% der Äpfel verkauft, am Dienstag weitere 50 Stück und es werden 100 neue Äpfel geliefert. Wie viele Äpfel bleiben übrig?Um die Anzahl der verbleibenden Äpfel zu berechnen, gehen wir Schritt für Schritt durch die Aufgabe:

1. Anfangsbestand:

- Das Obstgeschäft hat zu Beginn 200 Äpfel.

2. Verkauf am Montag:

- Es werden 30% der Äpfel verkauft. Um herauszufinden, wie viele das sind, berechnen wir 30% von 200.

0,30 x 200 = 60 Äpfel

- Nach dem Verkauf bleiben:

200 - 60 = 140 Äpfel

3. Verkauf am Dienstag:

- Am Dienstag werden weitere 50 Äpfel verkauft.

140 - 50 = 90 Äpfel

4. Lieferung:

- Es werden 100 neue Äpfel geliefert.

90 + 100 = 190 Äpfel

Ergebnis:

- Nach allen Verkäufen und der Lieferung verbleiben im Obstgeschäft insgesamt 190 Äpfel.Logische Schlussfolgerung

Löse folgendes Problem und erkläre dabei Schritt für Schritt deine Überlegungen:

Familie Müller plant einen Ausflug in den Zoo. Sie haben folgende Informationen:

Der Zoo ist 75 km entfernt.

Sie wollen um 10:00 Uhr im Zoo sein.

Die Fahrt dauert normalerweise 1 Stunde.

Sie brauchen 30 Minuten, um alle vier Familienmitglieder fertig zu

machen.

Das jüngste Kind braucht immer 20 Minuten extra Zeit zum Frühstücken.

Um wie viel Uhr müssen sie spätestens aufstehen, wenn sie pünktlich im Zoo ankommen wollen?Um zu bestimmen, wann Familie Müller spätestens aufstehen muss, gehen wir die Schritte rückwärts durch, um die gesamte benötigte Zeit zu berechnen:

1. Ankunftszeit im Zoo:

- Sie möchten um 10:00 Uhr im Zoo sein.

2. Fahrzeit zum Zoo:

- Die Fahrt dauert 1 Stunde. Daher müssen sie um 9:00 Uhr losfahren.

3. Zeit für das Fertigmachen:

- Sie benötigen 30 Minuten, um alle fertig zu machen. Das bedeutet, sie müssen um 8:30 Uhr mit dem Fertigmachen beginnen.

4. Extra Zeit für das jüngste Kind:

- Das jüngste Kind braucht 20 Minuten extra zum Frühstücken. Diese Zeit muss vor dem Fertigmachen eingeplant werden.

- Daher müssen sie spätestens um 8:10 Uhr mit dem Frühstück des jüngsten Kindes beginnen.

Schlussfolgerung:

- Um sicherzustellen, dass alles rechtzeitig erledigt wird, muss die Familie spätestens um 8:10 Uhr aufstehen.Chain of Thought sind sehr gut für die Lösung von komplexeren Problemen geeignet.

Role Prompting

Was ist das?

Role Prompting4 ist eine Technik, bei der einem KI-Modell eine spezifische Rolle oder Persona zugewiesen wird. Diese beeinflusst die Antwort. Indem das Modell in einen speziellen Kontext versetzt wird, soll die Antwort verbessert werden. Eine ausführliche Anleitung und weitere Beispiele kannst du hier kostenlos downloaden.

Vorteile:

- Verbesserte Genauigkeit bei komplexen oder fachspezifischen Aufgaben.

- Konsistente Antworten im Rahmen der zugewiesenen Rolle.

- Kreativität durch unerwartete Lösungsansätze.

- Personalisierung für spezifische Zielgruppen oder Kontexte.

Nachteile:

- Abhängigkeit von der gewählten Rolle; nicht jede Rolle ist für jede Aufgabe geeignet.

- Mögliche Überbetonung der Rollensichtweise, was zu einseitigen Antworten führen kann.

- Erfordert präzise Formulierung des Prompts, um die gewünschte Rolle klar zu definieren.

- Gefahr der Verwirrung, wenn die Rolle nicht gut verstanden wird.

Praktische Beispiele:

Mathematische Erklärung

Du bist ein geduldiger Mathematiklehrer für Grundschüler. Erkläre, wie man eine dreistellige Zahl mit einer zweistelligen Zahl multipliziert, am Beispiel von 293 x 94Natürlich, ich erkläre dir gerne, wie man eine dreistellige Zahl mit einer einstelligen Zahl multipliziert, am Beispiel von (293 \times 4).

Schritt 1: Schreibe die Zahlen untereinander

Zuerst schreiben wir die Zahlen so untereinander, dass wir sie leichter multiplizieren können:

293

× 4

_____

Schritt 2: Multipliziere jede Stelle der dreistelligen Zahl mit der einstelligen Zahl

Beginne von rechts nach links.

1. Multipliziere die Einerstelle von 293 mit 4:

- (3 x 4 = 12). Schreibe die 2 unten in die Ergebniszeile und merke dir die 1 (weil 12 eine zweistellige Zahl ist).

293

× 4

_____

2 (merke dir die 1)

2. Multipliziere die Zehnerstelle von 293 mit 4:

- (9 x 4 = 36). Addiere die gemerkte 1 dazu: (36 + 1 = 37).

- Schreibe die 7 ins nächste Feld der Ergebniszeile und merke dir die 3.

293

× 4

_____

72 (merke dir die 3)

3. Multipliziere die Hunderterstelle von 293 mit 4:

- (2 x 4 = 8). Addiere die gemerkte 3 dazu: (8 + 3 = 11).

- Schreibe die ganze Zahl (11) in die Ergebniszeile, da es keine weiteren Stellen mehr gibt.

293

× 4

_____

1172

Ergebnis:

Das Ergebnis von (293 x 4) ist also (1172).

So kannst du eine dreistellige Zahl mit einer einstelligen Zahl multiplizieren, indem du jede Stelle einzeln multiplizierst und dabei die Überträge merkst!Historische Perspektive

Du bist ein erfahrener Digital Marketing Manager mit 10 Jahren Erfahrung in der E-Commerce-Branche. Ein Start-up für nachhaltige Modeaccessoires bittet dich um Rat für ihre Online-Marketing-Strategie. Sie haben ein begrenztes Budget von 5.000 Euro pro Monat und möchten ihre Markenbekanntheit steigern sowie den Online-Verkauf ankurbeln. Erstelle einen detaillierten Marketingplan für die nächsten drei Monate, der folgende Punkte berücksichtigt:

- Zielgruppenanalyse

- Kanalauswahl und Budget-Allokation

- Content-Strategie

- SEO-Maßnahmen

- Social Media Marketing

- Influencer-Kooperationen

- E-Mail-Marketing

- Performance-Messung und KPIs

Begründe deine Empfehlungen basierend auf aktuellen Trends und Best Practices im E-Commerce für nachhaltige Mode.Hier ist ein detaillierter Marketingplan für das Start-up für nachhaltige Modeaccessoires mit einem Budget von 5.000 Euro pro Monat:

1. Zielgruppenanalyse

Zielgruppe:

- Demografisch: 18-35 Jahre, umweltbewusste Frauen und Männer, mittleres bis höheres Einkommen.

- Geografisch: Urbaner Raum, Schwerpunkt auf umweltfreundlichen Städten.

- Psychografisch: Wert legt auf Nachhaltigkeit, Modebewusstsein, Interesse an umweltfreundlichen Produkten.

Verhalten:

- Aktive Nutzer von Social Media.

- Häufiger Online-Shopper.

- Offen für neue Marken, wenn diese nachhaltige Werte vertreten.

2. Kanalauswahl und Budget-Allokation

Budget: 5.000 Euro pro Monat

- Social Media Advertising (30% - 1.500 Euro): Fokus auf Instagram und Facebook, da diese Plattformen gut für visuelle Produkte geeignet sind.

- Google Ads (20% - 1.000 Euro): Für gezielte Suchanfragen und Remarketing-Kampagnen.

- Influencer Marketing (25% - 1.250 Euro): Kooperation mit Mikro-Influencern im Bereich Nachhaltigkeit und Mode.

- SEO-Maßnahmen (10% - 500 Euro): Investition in Keyword-Recherche und On-Page Optimierung.

- E-Mail-Marketing (10% - 500 Euro): Aufbau und Pflege einer Mailingliste zur Kundenbindung.

- Content-Erstellung (5% - 250 Euro): Für die Erstellung von hochwertigen Bildern und Blog-Beiträgen.

3. Content-Strategie

- Visueller Content: Hochwertige Fotos von Produkten im Einsatz, kurze Videos zu Herstellung und Nachhaltigkeit.

- Blog: Wöchentliche Artikel über nachhaltige Mode, Tipps zum Umweltschutz und die Geschichte hinter den Produkten.

- User-generated Content: Kunden dazu ermutigen, Fotos ihrer gekauften Produkte zu teilen.

4. SEO-Maßnahmen

- Keyword-Recherche: Fokus auf Long-Tail-Keywords wie „nachhaltige Modeaccessoires“.

- On-Page Optimierung: Optimierung von Produktseiten mit Meta-Tags, Alt-Tags und Keyword-Dichte.

- Backlinks: Aufbau von Links durch Gastbeiträge auf Modeblogs.

5. Social Media Marketing

- Instagram & Facebook: Tägliche Posts, Stories und Reels mit Produkten und Kundenmeinungen.

- Engagement: Interaktion mit Followern durch Umfragen und Q&A-Sessions.

- Hashtags: Nutzung von spezifischen Hashtags wie #SustainableFashion.

6. Influencer-Kooperationen

- Mikro-Influencer: Zusammenarbeit mit Influencern aus dem Bereich Nachhaltigkeit mit 5.000 bis 20.000 Followern.

- Kampagnen: Gewinnspiele oder Rabattcodes, um die Reichweite zu erhöhen.

7. E-Mail-Marketing

- Newsletter: Monatliche Updates zu neuen Produkten, Blog-Beiträgen und Sonderaktionen.

- Automatisierung: Begrüßungssequenz für neue Abonnenten mit exklusiven Angeboten.

8. Performance-Messung und KPIs

- KPIs: - Markenbekanntheit: Anstieg der Social Media Follower um 20% pro Monat.

- Verkäufe: Steigerung der Online-Verkäufe um 10% monatlich.

- Website-Traffic: Erhöhung des organischen Traffics um 15%.

- E-Mail-Abonnenten: Wachstum der Liste um 5% pro Monat.

Tools zur Messung:

- Google Analytics für Website-Traffic und Conversions.

- Facebook Insights und Instagram Analytics für Social Media Engagement.

- E-Mail-Marketing-Plattformen zur Überwachung der Öffnungsraten und Klickraten.

Durch eine sorgfältige Planung und Umsetzung dieser Strategie kann das Start-up seine Markenbekanntheit effektiv steigern und den Online-Verkauf in den nächsten drei Monaten ankurbeln.Die Erstellung von spezifischen Inhalten ist sehr gut mit Role Prompting möglich.

Conversational Prompting

Was ist das?

Conversational Prompting nutzt einen natürlichen, dialogbasierten Ansatz in der Interaktion mit KI-Modellen. Die Methode simuliert ein Gespräch, bei dem das Modell und der Benutzer in einem kontinuierlichen Austausch stehen. Der Benutzer beginnt mit einer Frage oder Aufgabenstellung, und das Modell antwortet, wobei es den Kontext des gesamten Gesprächs beibehält.

Vorteile:

- Natürliche, intuitive Interaktion mit dem KI-Modell.

- Anpassung der Gesprächsrichtung basierend auf neuen Erkenntnissen.

- Detailgenauigkeit durch gezielte Nachfragen zu spezifischen Aspekten.

- Kontextuelle Relevanz, da das Modell auf vorherige Informationen zurückgreifen kann.

Nachteile:

- Erfordert möglicherweise mehr Zeit für die Problemlösung im Vergleich zu direkten Antworten.

- Abhängigkeit von der Fähigkeit des Benutzers, klare Fragen zu stellen.

- Kann in längeren Gesprächen schwierig sein, den Überblick über den Kontext zu behalten.

- Risiko von Missverständnissen, wenn die Fragen nicht präzise formuliert sind.

Praktisches Beispiel:

Reiseplanung

Ich plane eine Reise nach Japan. Kannst du mir bei der Reiseplanung helfen? Welche Fragen hast du?Gerne helfe ich dir bei der Planung deiner Reise nach Japan. Um dir die bestmöglichen Empfehlungen zu geben, habe ich ein paar Fragen:

1. Reisedauer: Wie lange planst du in Japan zu bleiben?

2. Reisezeitraum: Wann möchtest du reisen? Dies kann die Wetterbedingungen und Events beeinflussen.

3. Interessen: Welche Art von Aktivitäten interessieren dich am meisten? (z. B. Kultur, Natur, Shopping, Essen)

4. Budget: Hast du ein bestimmtes Budget im Kopf, das dich bei der Auswahl von Unterkünften und Aktivitäten leiten könnte?

5. Reisegruppe: Reist du allein, mit Freunden oder Familie?

6. Orte: Gibt es spezifische Städte oder Sehenswürdigkeiten, die du unbedingt besuchen möchtest?

7. Transport: Bevorzugst du den Zug, Mietwagen oder öffentliche Verkehrsmittel?

8. Besondere Wünsche: Gibt es etwas Spezielles, das du erleben oder sehen möchtest?

Mit diesen Informationen kann ich dir eine maßgeschneiderte Reiseroute und Tipps zusammenstellen.1. 7 Tage

2. April

3. Ich interessiere mich für die Geschichte Japans

4. maximal 1500 EUR

5. Zusammen mit einer Freundin

6. mach mir Vorschläge

7. öffentliche Verkehrsmittel

8. Ich interessiere mich für MangaBasierend auf deinen Angaben habe ich eine siebentägige Reiseroute für dich und deine Freundin zusammengestellt, die euren Interessen an Geschichte und Manga gerecht wird. Der April ist eine großartige Zeit für einen Besuch in Japan, da die Kirschblüte (Sakura) oft zu dieser Zeit in voller Blüte steht.

Tag 1: Ankunft in Tokio

- Check-in im Hotel: Nutzt ein zentral gelegenes Hotel in Tokio, um die Stadt effizient zu erkunden.

- Nachmittag/Abend: Spaziergang durch Akihabara, das berühmte Elektronik- und Manga-Viertel. Besucht Manga-Läden und themenbezogene Cafés.

Tag 2: Tokio

- Morgen: Besuch des Edo-Tokyo Museums, um mehr über die Geschichte der Stadt zu erfahren.

- Nachmittag: Erkundet den historischen Stadtteil Asakusa mit dem Senso-ji-Tempel.

- Abend: Genießt die Aussicht vom Tokyo Skytree und entdeckt die benachbarten Einkaufszentren.

Tag 3: Nikko (Tagesausflug)

- Früher Start: Fahrt mit dem Zug nach Nikko.

- Aktivitäten: Besichtigt den Toshogu-Schrein, ein UNESCO-Weltkulturerbe, und die umliegende Natur.

- Rückkehr nach Tokio am Abend.

Tag 4: Kamakura (Tagesausflug)

- Reise nach Kamakura: Eine historische Stadt südlich von Tokio.

- Sehenswürdigkeiten: Besucht den Großen Buddha (Daibutsu) und erkundet die vielen alten Tempel und Schreine.

- Rückkehr nach Tokio am Abend.

Tag 5: Kyoto

- Fahrt nach Kyoto: Mit dem Shinkansen von Tokio aus.

- Nachmittag: Besuch des Kinkaku-ji (Goldener Pavillon).

- Abend: Spaziergang durch das historische Viertel Gion und genießt traditionelle Kyotoer Küche.

Tag 6: Kyoto

- Morgen: Fushimi Inari-Taisha mit seinen endlosen Torii-Toren.

- Nachmittag: Erkundet den Arashiyama-Bambuswald und besucht das nahegelegene Iwatayama Monkey Park.

- Abend: Besucht ein traditionelles Onsen (heiße Quelle) zur Entspannung.

Tag 7: Rückkehr nach Tokio und Abreise

- Morgen: Rückfahrt nach Tokio.

- Nachmittag: Letzte Einkäufe in Shibuya oder Harajuku.

- Abend: Transfer zum Flughafen für den Rückflug.

Zusätzliche Tipps

- Japan Rail Pass: Ein 7-Tage-Pass kann sich lohnen, wenn ihr plant, zwischen Tokio und Kyoto mit dem Shinkansen zu reisen.

- Budget halten: Nutzt günstige Unterkünfte wie Business-Hotels oder Hostels. Vermeidet teure Restaurants zugunsten von lokalen Izakayas oder Convenience Stores.

- Manga und Anime: Plant Besuche in Manga-Museen oder Anime-Stores, insbesondere in Akihabara oder Nakano Broadway in Tokio.

Ich hoffe, diese Reiseroute passt gut zu euren Interessen und eurem Budget. Viel Spaß auf eurer Reise nach Japan!Ich würde gern den Meiji-Schrein, den Ueno-Park sowie den Kaiserpalast besuchen. Kannst du die Planung bitte anpassen und einen größeren Schwerpunkt auf Tokyo legen?Natürlich, ich passe die Reiseroute an, um einen größeren Schwerpunkt auf Tokio zu legen und die von dir gewünschten Sehenswürdigkeiten zu integrieren.

Tag 1: Ankunft in Tokio

- Check-in im Hotel: Wählt ein zentral gelegenes Hotel, um die Stadt bequem zu erkunden.

- Nachmittag/Abend: Spaziergang durch Akihabara, das berühmte Elektronik- und Manga-Viertel. Besucht Manga-Läden und themenbezogene Cafés.

Tag 2: Tokio

- Morgen: Besuch des Meiji-Schreins, einem der bedeutendsten Shinto-Schreine in Tokio, umgeben von einem schönen Wald.

- Nachmittag: Erkundet Harajuku für trendige Modegeschäfte und Cafés.

- Abend: Genießt die Aussicht vom Tokyo Skytree und entdeckt die benachbarten Einkaufszentren.

Tag 3: Tokio

- Morgen: Besuch des Kaiserpalastes. Macht eine Tour durch die Gärten, da der innere Palastbereich nur an bestimmten Tagen zugänglich ist.

- Nachmittag: Spaziergang durch den Ueno-Park, bekannt für seine Museen und Kirschblüten.

- Abend: Abendessen in Asakusa und Besuch des Senso-ji-Tempels.

Tag 4: Nikko (Tagesausflug)

- Früher Start: Fahrt mit dem Zug nach Nikko.

- Aktivitäten: Besichtigt den Toshogu-Schrein und erkundet die umliegende Natur.

- Rückkehr nach Tokio am Abend.

Tag 5: Kamakura (Tagesausflug)

- Reise nach Kamakura: Eine historische Stadt südlich von Tokio.

- Sehenswürdigkeiten: Besucht den Großen Buddha (Daibutsu) und erkundet die vielen alten Tempel und Schreine.

- Rückkehr nach Tokio am Abend.

Tag 6: Tokio

- Morgen: Besucht das Edo-Tokyo Museum, um mehr über die Geschichte der Stadt zu erfahren.

- Nachmittag: Zeit für Shopping oder weitere Erkundungen in Shibuya oder Ginza.

- Abend: Genießt ein Abschiedsessen in einem traditionellen Izakaya.

Tag 7: Abreise

- Letzter Vormittag in Tokio: Nutzt die verbleibende Zeit für einen entspannten Spaziergang oder letzte Einkäufe.

- Nachmittag: Transfer zum Flughafen für den Rückflug.

Zusätzliche Tipps

- Japan Rail Pass: Für die Ausflüge nach Nikko und Kamakura könnte sich ein regionaler Pass lohnen.

- Öffentliche Verkehrsmittel: Nutzt die U-Bahn und Züge in Tokio für effiziente Fortbewegung.

- Budget halten: Nutzt günstige Essensmöglichkeiten wie Street Food oder Convenience Stores.

Diese angepasste Reiseroute konzentriert sich mehr auf Tokio und beinhaltet alle gewünschten Sehenswürdigkeiten. Viel Spaß bei eurer Reise!Das Conversational Prompting nutze ich immer, wenn ich das fertige Ergebnis oder den Lösungsweg noch nicht kenne.

Template-Based Prompting

Was ist das?

Template-Based Prompting ist eine strukturierte Methode, mit der konsistente und zielgerichtete Antworten erzeugt werden. Die Technik nutzt vordefinierte Strukturen oder Vorlagen, um die Ergebnisse zu steuern.

Vorteile:

- Verbesserte Klarheit und Konsistenz in den Ausgaben.

- Reduzierte Abschweifungen, da das KI-Modell auf relevante Informationen fokussiert.

- Zeitersparnis bei der Erstellung von Prompts.

- Anpassbarkeit für verschiedene Aufgaben und Formate.

Nachteile:

- Falsche Templateauswahl kann zu unnatürlichen Ausgaben führen.

- Einschränkung der Kreativität des KI-Modells.

- Überabhängigkeit von Vorlagen kann eigenständiges Denken einschränken.

Praktische Beispiele:

Reisebericht-Template:

Reiseziel: [ORT]

Reisezeitraum: [DATUM] bis [DATUM]

Übersicht:

[ORT] ist ein [BESCHREIBUNG] Ort, bekannt für [HAUPTATTRAKTIONEN].

Highlights der Reise:

1. [HIGHLIGHT 1]: [KURZE BESCHREIBUNG]

2. [HIGHLIGHT 2]: [KURZE BESCHREIBUNG]

3. [HIGHLIGHT 3]: [KURZE BESCHREIBUNG]

Kulinarische Erfahrungen:

- Lokale Spezialität: [GERICHT]

- Empfohlenes Restaurant: [NAME], bekannt für [SPEZIALITÄT]

Unterkunft:

Wir übernachteten im [HOTEL/UNTERKUNFT], das sich durch [BESONDERHEIT] auszeichnete.

Transportmittel:

Wir nutzten hauptsächlich [TRANSPORTMITTEL], was [VORTEILE] bot.

Insider-Tipp:

[GEHEIMTIPP oder BESONDERE EMPFEHLUNG]

Fazit:

[ORT] ist ideal für [ZIELGRUPPE] und bietet [ZUSAMMENFASSUNG DER ERFAHRUNG].Projektvorschlag-Template:

Projekttitel: [TITEL]

Zusammenfassung:

[KURZE BESCHREIBUNG des Projekts in 2-3 Sätzen]

Ziele:

1. [HAUPTZIEL 1]

2. [HAUPTZIEL 2]

3. [HAUPTZIEL 3]

Hintergrund und Begründung:

[ERKLÄRUNG, warum das Projekt wichtig ist und welche Probleme es löst]

Methodik:

[BESCHREIBUNG der geplanten Vorgehensweise]

Zeitplan:

- Phase 1 ([ZEITRAUM]): [AKTIVITÄTEN]

- Phase 2 ([ZEITRAUM]): [AKTIVITÄTEN]

- Phase 3 ([ZEITRAUM]): [AKTIVITÄTEN]

Benötigte Ressourcen:

- Personal: [ANZAHL und QUALIFIKATIONEN]

- Budget: [GESCHÄTZTE KOSTEN]

- Ausrüstung: [LISTE DER BENÖTIGTEN MATERIALIEN]

Erwartete Ergebnisse:

[BESCHREIBUNG der erwarteten Outcomes und ihres Nutzens]

Risiken und Herausforderungen:

[AUFLISTUNG möglicher Probleme und Lösungsansätze]

Schlussfolgerung:

[ZUSAMMENFASSUNG der Hauptpunkte und abschließende Empfehlung]Mit Template-Based Prompting kann man super Inhalte oder Berichte erstellen.

Häufig gestellte Fragen zu Prompt Engineering

Was ist eigentlich Prompt Engineering?

Prompt Engineering ist die Fähigkeit, präzise Anweisungen (Prompts) für KI-Modelle zu formulieren, um optimale Ergebnisse zu erzielen. Es ist wie das Verfassen eines perfekten Briefings – je besser die Anweisung, desto besser das Ergebnis.

Brauche ich Programmierkenntnisse für Prompt Engineering?

Nein, Prompt Engineering basiert hauptsächlich auf klarer Kommunikation. Programmierkenntnisse sind nicht erforderlich, können aber in fortgeschrittenen Szenarien nützlich sein.

Welche Prompt-Technik eignet sich am besten für Anfänger?

Zero-Shot Prompting ist der beste Einstieg, da es die einfachste Form ist. Du gibst eine direkte Anweisung ohne komplexe Strukturen oder Beispiele.

Wie lang sollte ein guter Prompt sein?

Ein effektiver Prompt kann von einem Satz bis zu mehreren Absätzen reichen. Wichtiger als die Länge ist die Präzision. Als Faustregel gilt: So kurz wie möglich, so ausführlich wie nötig.

Wie verhindere ich, dass die KI vom Thema abschweift?

Nutze klare Strukturen und Template-Based Prompting. Definiere auch explizit, was die KI NICHT tun soll. Beispiel: “Konzentriere dich ausschließlich auf [Thema] und lasse verwandte Themen außen vor.

Kann man als Prompt Engineer Geld verdienen?

Ja, die Nachfrage nach Prompt Engineers wächst. Gehälter liegen typischerweise zwischen 50.000 und 70.000 € brutto pro Jahr. Tendenz steigend.

Wie kombiniere ich verschiedene Prompt-Techniken effektiv?

Beginne mit einer Haupttechnik und ergänze sie nach Bedarf. Beispiel: Starte mit Template-Based Prompting und füge Role Prompting hinzu, wenn spezifische Expertise gefragt ist.

Wie gehe ich mit mehrstufigen Aufgaben um?

Nutze Chain of Thought Prompting oder teile die Aufgabe in kleinere, aufeinanderfolgende Prompts auf. Stelle sicher, dass jeder Schritt auf dem vorherigen aufbaut.

Wird Prompt Engineering durch KI-Fortschritte überflüssig?

Nein, im Gegenteil. Je fortschrittlicher KI-Systeme werden, desto wichtiger wird präzise Kommunikation mit ihnen. Prompt Engineering entwickelt sich weiter und wird komplexer.

Schreibe einen Kommentar