Was du in diesem Guide lernst

- Wie du den OpenAI API-Key einrichtest und in n8n verbindest

- Welches Modell (ChatGPT, Claude oder Gemini) für welchen Zweck taugt

- 4 konkrete Workflow-Beispiele mit Schritt-für-Schritt-Erklärung

- Wie der AI Agent Node funktioniert und wann du ihn brauchst

- Wie ChatGPT selbst n8n-Workflows auslösen kann (Custom GPT Actions)

- Wie du API-Kosten um bis zu 80 % reduzierst

n8n und ChatGPT zusammen sind eine der wirkungsvollsten Kombinationen in der Automatisierung im Moment. n8n übernimmt die Logik und die Verbindung zu externen Diensten, ChatGPT bringt das Sprachverständnis und die Generierungsfähigkeit. Was dabei entsteht, sind Workflows, die nicht nur Daten weiterschieben, sondern mit diesen Daten denken und handeln.

In diesem Guide zeige ich dir, wie du ChatGPT direkt mit n8n verbinden kannst, welche LLM-Modelle wirklich sinnvoll sind und was mit dieser Kombination alles möglich ist. Inklusive eines weitgehend unbekannten Winkels: ChatGPT kann n8n nicht nur bedienen, es kann n8n auch auslösen.

- OpenAI API-Key erstellen auf platform.openai.com

- In n8n: Credentials → New → OpenAI API → Key eintragen

- Workflow mit “OpenAI” oder “AI Agent” Node aufbauen

- Modell wählen, Prompt setzen, testen

Inhaltsverzeichnis

Was bedeutet “n8n mit ChatGPT verbinden” genau?

Wenn du n8n mit ChatGPT verbindest, sprichst du eigentlich mit der OpenAI-API. Du brauchst keinen ChatGPT-Plus-Account, sondern einen API-Key von platform.openai.com. Das geht auch ohne Abo. Der Vorteil des API-Zugriffs: Du bezahlst nur, was du tatsächlich verbrauchst. n8n kommuniziert direkt und unabhängig von der ChatGPT-Weboberfläche.

In n8n gibt es zwei verschiedene Wege, ChatGPT einzusetzen.

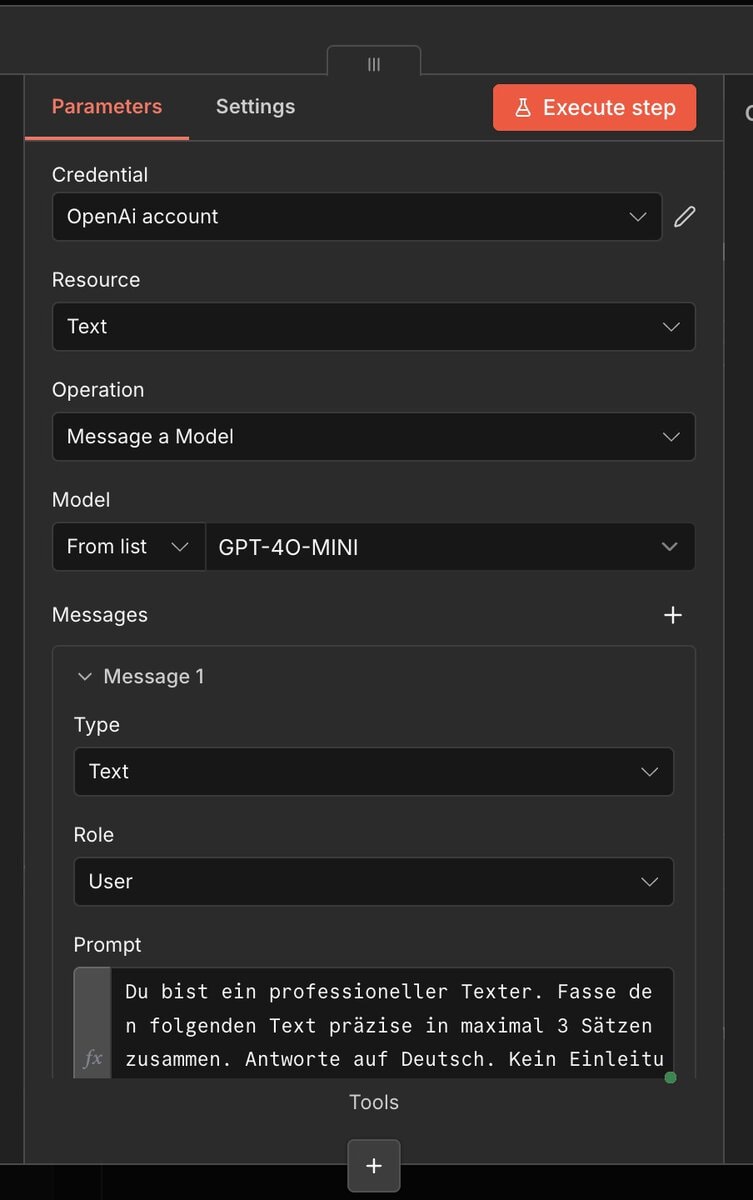

OpenAI Node: einmaliger Aufruf

Der einfachste Weg. Du gibst Text oder Daten rein, GPT gibt dir Text raus. Perfekt für klare Aufgaben: Zusammenfassen, Übersetzen, Klassifizieren, E-Mail-Entwürfe schreiben. Der Workflow läuft linear durch, ChatGPT ist ein Schritt davon.

AI Agent Node: autonomes Handeln

Der AI Agent Node gibt ChatGPT die Kontrolle über Entscheidungen und den Einsatz von Werkzeugen. Du sagst dem Agenten, was er erreichen soll, und stellst ihm Tools zur Verfügung: Web-Suche, Google Sheets, HTTP Request, Slack. Das LLM entscheidet selbst, welche Tools es in welcher Reihenfolge einsetzt. Der Agent ist nicht auf einen Schritt begrenzt.

Zwei Richtungen der Verbindung

Die meisten Anleitungen zeigen nur eine Richtung: n8n ruft ChatGPT auf. Es gibt aber auch die umgekehrte Richtung. Mit Custom-GPT-Actions kann ChatGPT selbst n8n-Workflows auslösen. Dazu komme ich in Abschnitt 6.

Wie richtest du die OpenAI-Verbindung in n8n ein?

Die Einrichtung dauert unter 10 Minuten. Du brauchst einen OpenAI-Account, ein laufendes n8n und nichts weiter.

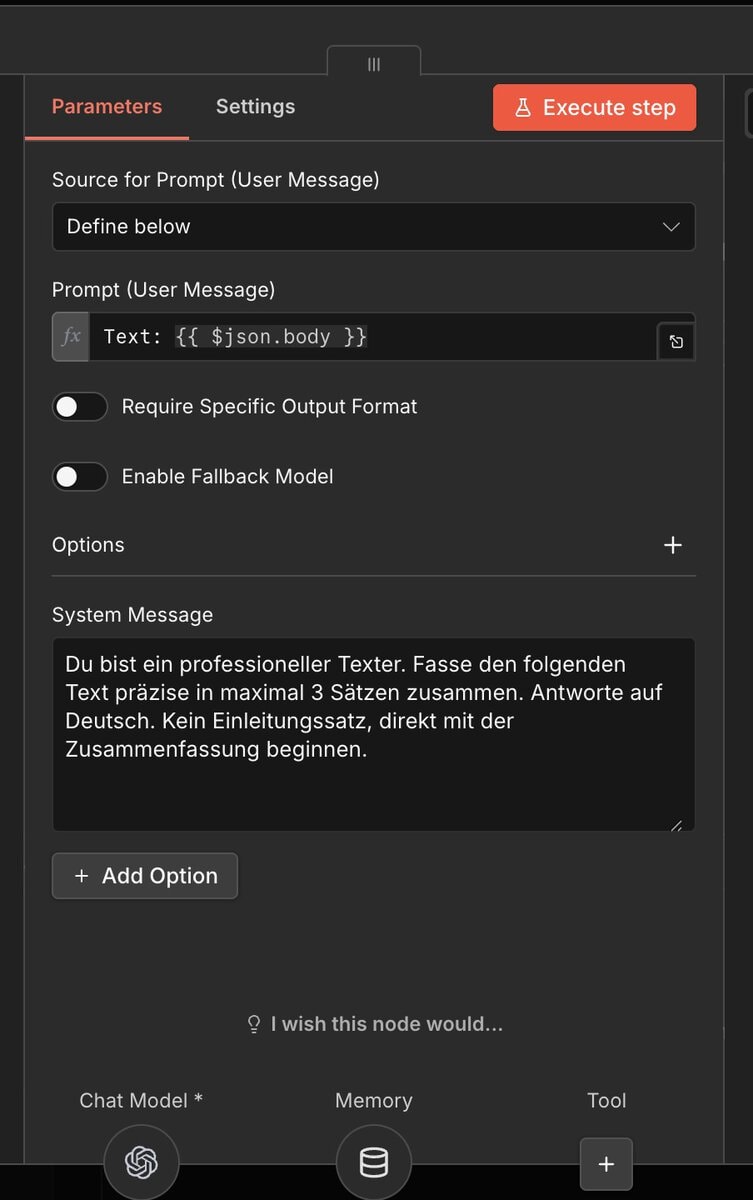

gpt-4o-mini für günstige Tasks oder gpt-4o für komplexe Anforderungen. Im System Prompt definierst du das Verhalten, im User Prompt übergibst du Daten via {{ $json.feldname }}.

{{ $json.message.content }} für den nächsten Node.

Prompt-Aufbau: So übergibst du Daten aus anderen Nodes

Der häufigste Einstiegsfehler: Der Prompt ist statisch, dabei lebt die Stärke von n8n in der dynamischen Datenübergabe. So sieht ein typischer Prompt aus:

{{ $('NodeName').item.json.feld }} auf Daten aus beliebigen vorherigen Nodes im Workflow zugreifen, nicht nur auf den direkt vorherigen.

ChatGPT, Claude oder Gemini: Welches Modell passt zu welchem Workflow?

n8n unterstützt alle großen LLM-Anbieter nativ. Du kannst OpenAI, Anthropic (Claude), Google (Gemini) und lokale Modelle via Ollama mit einem einzigen Credential-Wechsel austauschen.

| Anbieter | Modell (2026) | Stärken in n8n | DSGVO | Empfohlen für |

|---|---|---|---|---|

| OpenAI | GPT-4o, GPT-4o-mini | Allround, DALL-E-Integration, breite API-Reife | ⚠ US-Server | Allgemeine Workflows, Bildgenerierung |

| Anthropic | Claude Sonnet 4.6, Haiku 4.5 | Lange Kontextfenster, präzise Instruktionstreue | ⚠ US-Server | Lange Dokumente, Content-Generierung |

| Gemini 2.0 Flash, Pro | Günstigstes Preis-Leistungs-Verhältnis, schnell | ⚠ US-Server | Hohe Volumen, einfache Klassifizierungen | |

| Ollama (lokal) | Llama 3.3, Mistral Large, Phi-4 | Komplett lokal, keine API-Kosten | ✓ lokal | DSGVO-sensitive Daten, interne Prozesse |

Meine eigene Erfahrung mit der Modellwahl

In meinem Pixios-Content-Workflow laufen fünf parallele KI-Aufrufe pro Amazon-Produkt. Ich habe lange mit Claude Sonnet gearbeitet. Später dann Claude Haiku für die einfacheren Content-Tasks getestet. Die Qualität war für Social-Media-Posts gleichwertig, die API-Kosten sanken um über 80 Prozent. Für komplexes Reasoning bleibt Sonnet oder GPT-4o meine Wahl. Für Massenverarbeitung kurzer Texte ist Haiku oder GPT-4o-mini die klügere Entscheidung.

Welche Workflows kannst du mit n8n und ChatGPT bauen?

Die Kombination aus n8n-Logik und ChatGPT-Sprachverständnis funktioniert überall dort gut, wo Texte verarbeitet, bewertet oder generiert werden müssen.

E-Mail-Assistent

Einstieg · ca. 20 Min.

Eingehende E-Mails werden per Gmail-Trigger empfangen, an ChatGPT übergeben und automatisch zusammengefasst oder mit einem Antwort-Entwurf versehen. Der Entwurf landet als Vorlage im Postfach. Benachrichtigungen über priorisierte Anfragen gehen per Slack.

Lead-Generierung und Qualifizierung

Fortgeschritten · ca. 30 Min.

Kontaktformular-Einträge werden per Webhook empfangen. KI-gestützte Bewertung durch ChatGPT gibt einen Score: Hot, Warm oder Cold. Je nach Score folgt eine andere Aktion im CRM. Leads lassen sich so automatisch priorisieren.

Content-Generierung

Fortgeschritten · ca. 30 Min.

Ein Input-Datensatz (Produkt-URL, Keyword, Thema) wird an mehrere parallele ChatGPT-Aufrufe gesendet. Jeder Aufruf generiert einen anderen Content-Typ: Blog Posts, Social Media Content, Produkttexte. Skaliert auf 100 Eingaben ohne zusätzlichen Aufwand.

Social Media Management

Fortgeschritten · ca. 25 Min.

Themen oder RSS-Feeds kommen rein, ChatGPT generiert plattformspezifische Posts für LinkedIn, Instagram und Twitter/X. Templates sorgen für konsistente Tonalität. Veröffentlichung läuft automatisch oder landet zur Freigabe in einem Google Sheet.

Chatbot mit Gedächtnis

Fortgeschritten · ca. 45 Min.

Ein Webhook empfängt Nutzeranfragen, der AI Agent Node verarbeitet sie mit Zugriff auf frühere Nachrichten. Der Window Buffer Memory Node speichert die Gesprächshistorie. Ideal für Support-Bots oder interne Assistenten.

Prompt Chaining: Mehrere Modelle hintereinanderschalten

Du verbindest mehrere OpenAI-Nodes hintereinander. Der Output des ersten Aufrufs wird zum Input des zweiten. n8n übergibt Daten automatisch zwischen Nodes.

Das Ergebnis von Schritt 1 landet in $json.message.content. Der zweite Node greift über den Node-Namen darauf zu:

Wie funktioniert der AI Agent Node mit ChatGPT?

Der AI Agent Node ist der wichtigste Unterschied zwischen n8n und simplen Automatisierungstools. Statt ChatGPT einmalig zu fragen, gibst du dem Modell Kontrolle über einen Werkzeugkasten. Das Modell entscheidet selbst, welche Werkzeuge es braucht und wann es fertig ist.

Aufbau eines AI Agent Setups

Der Agent-Node braucht immer mindestens zwei verbundene Sub-Nodes:

- Chat Model: Den KI-Anbieter deiner Wahl. “OpenAI Chat Model”, “Anthropic Chat Model” oder “Google Gemini Chat Model” stehen zur Auswahl. Wird unten links am Agent-Node verbunden.

- Tools: Jede Funktion, die der Agent aufrufen kann. HTTP Request, Google Sheets, Slack, Web-Suche. Werden unten rechts verbunden.

Optional: Ein Memory-Node hält die Gesprächshistorie über mehrere Aufrufe hinweg verfügbar.

Kann ChatGPT auch n8n-Workflows auslösen?

Ja, und das ist eine der interessantesten Möglichkeiten, die kaum jemand kennt. Mit “Custom GPT Actions” in ChatGPT Plus kannst du einen eigenen GPT erstellen, der beim Ausführen einer bestimmten Aufgabe deinen n8n-Webhook aufruft. ChatGPT wird damit zur natürlichen Sprach-Schnittstelle für deine n8n-Automatisierungen.

So sieht ein minimales OpenAPI-Schema aus, das du in Schritt 3 in den Schema-Editor einfügst:

Was kostet die ChatGPT-Integration in n8n?

| Modell | Kosten Input | Kosten Output | Empfehlung |

|---|---|---|---|

| GPT-4o-mini | $0,15 / 1M Tokens | $0,60 / 1M Tokens | Standard für einfache Tasks, sehr günstig |

| GPT-4o | $2,50 / 1M Tokens | $10,00 / 1M Tokens | Komplexes Reasoning, wichtige Entscheidungen |

| Claude Haiku 4.5 | $0,80 / 1M Tokens | $4,00 / 1M Tokens | Einfache Generierung, guter Stil |

| Claude Sonnet 4.6 | $3,00 / 1M Tokens | $15,00 / 1M Tokens | Komplexe Analyse, lange Dokumente |

| Gemini 2.0 Flash | $0,10 / 1M Tokens | $0,40 / 1M Tokens | Günstigstes Modell für Massenverarbeitung |

| Ollama (lokal) | 0 € | 0 € | Interne Daten, braucht eigene Hardware |

1.000 Tokens entsprechen ungefähr 750 deutschen Wörtern. Ein typischer Workflow-Prompt mit 200 Wörtern Input und 300 Wörtern Output kostet mit GPT-4o-mini weniger als 0,001 Euro. Bei 10.000 solchen Tasks pro Monat sind das unter 10 Euro. Mit GPT-4o wären es ca. 65 Euro für dieselbe Last. Bei Social Media Management mit 50 Posts täglich und durchschnittlich 500 Tokens pro Aufruf liegen die API-Kosten mit GPT-4o-mini unter 3 Euro im Monat. Der E-Mail-Assistent kommt bei 200 eingehenden E-Mails täglich und je 1.000 Tokens pro Zusammenfassung auf knapp 1 Euro im Monat.

- System Prompts so kurz wie möglich halten, sie werden bei jedem Aufruf mitgezählt

- Für Massenaufgaben auf Mini/Haiku/Flash wechseln

- API-Spending-Limits auf platform.openai.com setzen

Welche häufigen Fehler passieren beim Verbinden?

“Authentication Error” oder 401

Der API-Key ist falsch oder wurde nicht vollständig kopiert. Lösung: In n8n Credentials den Key neu eintippen (nicht einfügen, da Leerzeichen am Ende auftreten können) und mit “Test credential” prüfen.

“Rate Limit Exceeded” oder 429

Zu viele Aufrufe pro Minute. Lösung: Zwischen parallelen Aufrufen einen “Wait”-Node (1-2 Sekunden) einbauen. Neue Accounts starten auf Tier 1 mit niedrigen Limits, diese steigen automatisch nach ausreichend Nutzung.

Output wird abgeschnitten

Der Parameter “Max Tokens” ist zu niedrig. Im Node unter “Additional Options” den Wert auf 2.000 oder 4.000 erhöhen.

“Context Length” oder 400 bei sehr langen Texten

Der Input-Text ist länger als das Kontextfenster des gewählten Modells. GPT-4o-mini hat 128.000 Token Kontextfenster, was für die meisten Fälle reicht. Bei sehr langen Dokumenten vorher mit einem “Summarize”-Schritt oder einem Text-Splitter kürzen.

Antworten sind unzuverlässig oder halluzinieren

Das Modell erfindet Fakten oder antwortet nicht im erwarteten Format. Drei Maßnahmen helfen:

- Strukturierter Output: Im System Prompt das gewünschte Format explizit vorgeben, z.B. JSON mit konkreten Feldnamen oder eine nummerierte Liste mit fester Struktur.

- Validation-Schritt: Einen IF-Node nachschalten, der prüft ob das Format stimmt, bevor die Daten weiterlaufen.

- Temperatur senken: Unter “Additional Options” im Node die Temperature auf 0 oder 0.2 setzen für konsistentere, vorhersagbarere Ausgaben.

Häufig gestellte Fragen

Brauche ich ChatGPT Plus, um n8n mit ChatGPT zu verbinden?

Nein. Die n8n-Integration läuft über die OpenAI API, nicht über ChatGPT Plus. Du brauchst einen Account auf platform.openai.com und ein API-Guthaben. Beide Produkte sind getrennt und werden separat abgerechnet.

Welches ChatGPT-Modell ist am besten für n8n-Workflows?

Für die meisten Automatisierungen reicht GPT-4o-mini vollständig aus und kostet einen Bruchteil von GPT-4o. GPT-4o empfiehlt sich nur für komplexe Reasoning-Aufgaben. Im Zweifelsfall mit GPT-4o-mini starten.

Kann n8n auch mit mehreren KI-Modellen gleichzeitig arbeiten?

Ja. Du kannst in einem Workflow verschiedene Modelle für verschiedene Aufgaben einsetzen. Beispiel: GPT-4o-mini für Klassifizierung, Claude Sonnet für die Ausarbeitung, Gemini Flash für die Abschlusskontrolle. Jeder Node hat seine eigene Credential.

Ist die n8n-ChatGPT-Integration DSGVO-konform?

Die OpenAI API verarbeitet Daten auf US-Servern. Für personenbezogene Daten von EU-Bürgern ist eine Prüfung nötig. Wer volle Datenkontrolle braucht, nutzt Ollama mit lokalen Modellen auf dem eigenen Server.

Gibt es ein Limit, wie viele API-Aufrufe ich machen kann?

OpenAI hat Rate Limits, die von deinem Account-Tier abhängen. Neue Accounts starten auf Tier 1. Das reicht für die meisten Workflows. Der Tier steigt automatisch nach ausreichend Nutzung. Aktuelle Limits unter platform.openai.com/account/limits.

Funktioniert GPT-4 Vision (Bilder analysieren) auch in n8n?

Ja. Im OpenAI Node kannst du Bilder als URLs oder Base64 übergeben. GPT-4o und GPT-4o-mini unterstützen Vision. Damit lassen sich Quittungen auslesen, Screenshots analysieren oder Produktbilder beschreiben.

Wie übergebe ich ChatGPT die Ausgabe eines anderen Nodes?

Über n8n-Expressions im Prompt-Feld. Syntax: {{ $json.feldname }} für den vorherigen Node. Für einen bestimmten Node weiter vorne: {{ $('NodeName').item.json.feldname }}. Den Feldnamen siehst du im Output-Panel des vorherigen Nodes.

Schreibe einen Kommentar